Een zoektocht naar patronen

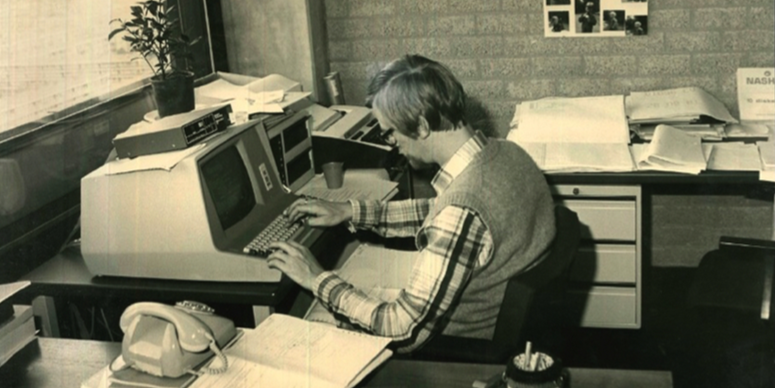

Bijbel en computer in Amsterdam aan het ETCBC

Sinds de oprichting in 1977, in een tijd waarin computers nog kamers vulden en gegevens op grote ponskaarten stonden, werd er in de Werkgroep Informatica Vrije Universiteit (WIVU) in Amsterdam gewerkt aan het mogelijk maken om de Bijbel met de computer te onderzoeken. Oorspronkelijk was het doel alleen een digitale concordantie en zoekprogramma’s te maken voor Bijbelonderzoek, maar de focus verschoof snel naar het bouwen van een database waarin de tekst van het Oude Testament van woord- tot tekstniveau geanalyseerd is met behulp van de computer. De database uit Amsterdam is niet de enige die er is, maar de principes waarmee hij is opgebouwd maken deze database uniek. Dit maakt dat de werkgroep na 48 jaar, zij het onder een nieuwe naam, nog altijd bestaat en doorwerkt aan de database. Rens Bod, verwijzend naar het werk van Eep Talstra, de oprichter van de werkgroep, sprak over de voortrekkersrol die Nederland gespeeld heeft in de ontwikkeling van onderzoek van het Oude Testament met computers.1 Het ETCBC heeft wereldwijd invloed gehad op hoe taalkundig en digitaal Bijbelonderzoek wordt gedaan – van onderzoeks- en vertaalprojecten tot software als Logos en Accordance. In dit artikel zullen we de geschiedenis langsgaan en kijken naar de ontwikkelingen en naar hoe Bijbel en computer hier in Amsterdam aan elkaar verbonden zijn.2

Van ponskaarten tot SHEBANQ

Hoe bouw je een database van een oude tekst zoals het Hebreeuwse Oude Testament op? Begin je bij het begrip van de tekst, en kijk je dan hoe het verhaal uit zinnen, zinnen uit zinsdelen en zinsdelen uit woorden bestaat? Eep Talstra, de oprichter van de WIVU, en zijn collega’s kozen voor de omgekeerde aanpak. Met een aantal instructies lieten ze de computer beginnen bij de kleinste delen, woorden, waarvan de vorm werd bepaald, en bouwden ze het van daaruit op tot zinsdelen, zinnen en tekstgedeelten. Door zo van onderaf te beginnen, bij de woorden en hun vorm, voordat je er functies en interpretaties aan toewijst, is de data zoveel mogelijk gebaseerd op taalkundige regels en patronen in de tekst zelf, en is deze minder afhankelijk van interpretatie en minder ad hoc.3

De eerste tien jaar besteedde de werkgroep aan de opbouw van de database. Met behulp van de computer werden de woorden van de Hebreeuwse tekst geanalyseerd en voorzien van grammaticale informatie, werden de eerste woordenboeken en concordanties gemaakt, en werd een begin gemaakt aan de verdere analyse van de tekst in zinsdelen, zinnen en hun functies en onderlinge relaties. Begin jaren 90 werd de database beschikbaar voor het bredere publiek. Het programma Quest werd ontwikkeld voor MS-DOS, waarin gebruikers met behulp van het programma een query (een zoekopdracht in een voor de computer begrijpelijke taal ),4 konden maken om de Hebreeuwse tekst te doorzoeken. Door nieuwe ontwikkelingen was het toen mogelijk geworden de gevonden woorden in Hebreeuwse tekens te laten zien op het scherm, zoals de onderzoekers gewend waren.

Pas na deze periode kreeg de werkgroep zijn eigen computers, en hoefde de onderzoekers niet meer berekeningen te doen op externe grote mainframecomputers. Dit gaf nieuwe mogelijkheden om de manier waarop de database werd opgeslagen en bewerkt te vernieuwen, en gaf ook de mogelijkheid er in lessen mee te werken.

Een opvolger van het Quest programma liet tot 2004 op zich wachten, toen het Duitse Bijbelgenootschap in samenwerking met Logos Bible Software de Stuttgart Electronic Study Bible (SESB) ontwikkelde. Naast andere tools voor Bijbelstudie bevatte het programma de WIVU-database. Ook was het programma nu geschikt voor Windows, en hoefde men geen query meer in te voeren, maar kon in een venster en door op knoppen te klikken de tekst bekeken en doorzocht worden.

Waar in Quest alle woorden van de Hebreeuwse tekst geanalyseerd waren, en 10% van de tekst voorzien was van verdere analyse in zinsdelen en zinnen, was dit in SESB 50%. Dit waren met name de verhalende gedeelten van het Oude Testament. Tussen 2005 en 2009 werd de rest van de tekst geanalyseerd, met speciale aandacht voor de profetische en poëtische stukken, waar veel gebruik wordt gemaakt van poëtische technieken zoals parallellisme.

Vanaf 2010 startte de WIVU een nieuw project; om de database te verrijken met nieuwe taalkundige data. Zo werd begonnen aan het toevoegen van valentiepatronen voor werkwoorden in de database. Met valentie doelt men op het aantal verbindingen dat een woord aangaat met andere woorden of zinsdelen om tot een bepaalde betekenis te komen. denk bijvoorbeeld aan het werkwoord ‘koken’. In de zin ‘Ik kook’ staat het werkwoord op zichzelf, en betekent het ‘een maaltijd bereiden’. Maar als je zegt “Ik kook spaghetti”, heeft het werkwoord een lijdend voorwerp en verandert de betekenis. Dit verschil is voor Hebreeuwse werkwoorden nog uitgesprokener, en deze patronen werden tussen 2010 en 2014 toegevoegd aan de database, en voor een paar werkwoorden uitgewerkt. Ook werd gekeken of het met de computer mogelijk was om personages in de teksten te kunnen vaststellen, ook als de tekst plotseling van onderwerp wisselt of informatie mist.

In 2011 ging Eep Talstra met pensioen, maar hij bleef verbonden aan de werkgroep. In 2013, met het aanstellen van Willem van Peursen als zijn opvolger, werd de werkgroep vernoemd naar zijn oprichter, en ging voortaan verder als het Eep Talstra Centre for Bible and Computer (ETCBC).

In de jaren die volgden werd de database op meer manieren beschikbaar gemaakt. In 2014 werd de SHEBANQ website gelanceerd, waar de Hebreeuwse tekst en de gegevens en analyse uit de database weergegeven kunnen worden, en waar de tekst met behulp van queries doorzocht kan worden. Ook werd de database in andere websites verwerkt, en kwam er de database als module voor het Bijbel programma Accordance beschikbaar. Ook werd in 2016 voor de programmeertaal Python software ontwikkeld, Text Fabric, om de tekst in Python te kunnen opvragen en verder verwerken.5

Vroege, late, Aramese en Griekse teksten

De focus van de werkgroep heeft vanaf het begin gelegen op de Hebreeuwse tekst van het Oude Testament. Maar de methode waarmee de computer tekst analyseert en een database opbouwt is ook toepasbaar op andere Hebreeuwse teksten, of zelfs op teksten in een andere taal. Van 1999 tot 2005 werd, in samenwerking met het Peshiṭta Instituut Leiden, gewerkt aan het maken van eenzelfde analyse van de Peshiṭta, een Syrische vertaling van het Oude en Nieuwe Testament. Door de Syrische vertaling van met name 1 en 2 Koningen te vergelijken met de Hebreeuwse tekst, kon verder inzicht verkregen worden in taalkundige ontwikkeling, invloed op de andere taal, vertaaltechnieken en meer. Tussen 2005 en 2010 werd deze methode uitgebreid naar meer boeken, naar de Targums en andere niet-Bijbelse Syrische teksten. Tussen 2013 en 2017 werden oude Hebreeuwse inscripties, Dode Zee-rollen en Hebreeuwse en Aramese Rabbijnse teksten aan de database toegevoegd. Daarna is er ook nog gewerkt aan het Griekse Nieuwe Testament, Ge’ez teksten en meer.

[citaat] Dit brede spectrum aan teksten maakt het mogelijk om taalvariatie beter te onderzoeken in meerdere bronnen en langere tijdsperioden. Dit onderzoek vindt plaats aan allerlei universiteiten die gebruik maken van de database, maar ook door projecten, artikelen en promotieonderzoeken in Amsterdam zelf.

Een zoektocht naar patronen

Wat al het onderzoek gemeen heeft, en wat vanaf het begin de werkgroep gedreven heeft, is een zoektocht naar patronen. Door patronen kan het menselijk brein taal van een groep losse tekens woorden maken, en van woorden zinnen die een samenhangend verhaal maken, en met patronen kunnen we de en betekenis vinden die in die context bedoeld wordt. Ons brein is een grote patronenmachine, die ons in staat stelt de wereld om ons heen te begrijpen en te voorspellen. Zo leren we ook taal in onze eerste jaren, begrijpen we grammaticale regels, en kunnen in een context opmaken wat een woord moet betekenen. Voor een hedendaagse taal kan je sprekers vragen naar zulke patronen, als ze zich daar bewust van zijn. Bij een dode taal zal het door onderzoek naar boven moeten komen. Door veel teksten te hebben die geanalyseerd zijn, kunnen met zoekopdrachten zulke patronen naar boven gehaald en bestudeerd worden. Zo krijgen we steeds beter inzicht hoe bijvoorbeeld het Bijbels Hebreeuws gewerkt heeft. En het is deze kennis die vervolgens de basis van onze interpretatie van de tekst. En zo beginnen we dus niet met onze interpretatie in de tekst te leggen, maar beginnen we met de tekst zelf en laten de woorden spreken. Vanuit de woorden en taalkundige processen en patronen bouwen we betekenis op, en kunnen zo gedegen onderbouwen wat een tekst kan zeggen en wat niet.

Dat is niet alleen nuttig bij het bestuderen van een vertaling, ook bij het maken ervan. Zo heeft de ETCBC input geleverd voor de vertaling van de Societas Hebraica Amstelodammes (SHA), en wordt sinds 2017 gewerkt aan een Bijbelvertaling in het Fries, gebaseerd op de database en gebaseerd op proefvertalingen gemaakt door een programma dat Eep Talstra ontwikkeld heeft. En mijn promotieonderzoek bekijkt hoe valentiepatronen gebruikt kunnen worden om verantwoord concordant te vertalen, door vanuit de taal aan te wijzen waar een woord ook daadwerkelijk dezelfde betekenis heeft, en dus hetzelfde vertaald kan worden, en waar niet.6

Zo helpen de patronen die we ontdekken met de ETCBC database en de computer een betere Bijbelvertaling te kunnen maken, en de Bijbel beter te begrijpen. Je zou kunnen zeggen dat dit vroeger ook gedaan kon worden met de hand, met de concordanties, woordenboeken en andere boeken die we hadden. Maar [citaat] de computer heeft wel degelijk voor veel verandering en vernieuwing gezorgd. Niet alleen versnelt het het onderzoek enorm – het opzoeken van alle voorkomens van een woord duurt een fractie van een seconde, in plaats van uren – maar het maakt veel mogelijk wat voorheen buiten bereik lag. Zeker als het gaat om complexere zoekopdrachten en analyses, om de hoeveelheid data die een computer kan opslaan en verwerken, wat onpraktisch was geweest om in boeken te publiceren. Computers zijn bij uitstek geschikt voor het zoeken naar en analyseren van patronen.7

Een blik vooruit – nieuwe patronen met AI?

Zo is er in 48 jaar een uitgebreide database opgebouwd en is er veel werk verzet en gepubliceerd. Bijbelonderzoek met de computer is relevanter dan ooit. Het is niet meer exclusief voor een paar voortrekkers aan enkele universiteiten. De computer wordt nu overal gebruikt voor onderzoek, en iedereen kan op zijn telefoon apps downloaden waarop met enkele klikken grote databases zoals die van de ETCBC, met decennia aan onderzoek erachter, te kunnen raadplegen en doorzoeken. En het werk gaat nog altijd door. Er lopen projecten om de database verder te verrijken, verder uit te breiden met nieuwe teksten, en er lopen nog tal van onderzoeken die de zoektocht naar patronen in de data doorzetten.

De stormachtige ontwikkeling van AI de afgelopen jaren heeft de computer nog meer op de voorgrond gezet. Nu is het mogelijk om computers vragen te stellen, waarop ze vol vertrouwen uitgebreid antwoord geven. De computer is nu in staat taal te begrijpen, te analyseren en opdrachten uit te voeren. De hoop is dat computers over enkele jaren in staat zijn zelfstandig onderzoek te doen, en zo de ontwikkelingen nog meer te versnellen. En als AI ergens over gaat, dan is dat patronen vinden in tekst. Maar wie nu de verschillende grote taalmodellen (LLMs) wat uitgebreider test, zal al snel zien dat het resultaat soms correct is en soms slechts correct lijkt, maar er volkomen naast zit.

Voor onderzoek moet AI dus nog voorzichtig gebruikt worden, en de uitkomsten moeten uitvoerig getest worden. Toch wordt er ook aan het ETCBC al in verschillende projecten gekeken naar de mogelijkheden en onmogelijkheden van AI. Zo is er tussen 2021 en 2022 onderzoek gedaan naar het gebruik van AI voor het analyseren van woorden van een nieuwe tekst, en wordt sinds 2023 onderzoek gedaan naar door AI gegenereerde Bijbelse kunst. Vanaf 2024 is Matthijs de Jong, in een samenwerking van de VU, het NBG en Universiteit Utrecht, een project gestart naar de inzetbaarheid van het AI in het vertaalproces. Uit de eerste resultaten blijkt dat het taalmodel verrassend goede conceptvertalingen kan maken in de gevraagde stijl, en ook scherpe observaties kan doen als het gevraagd wordt de vertaling na te kijken, maar telkens blijken de resultaten wisselend, en blijft er een zekere onvoorspelbaarheid in zitten.8

We zullen moeten aankijken hoe dit zich verder ontwikkelt, maar het is duidelijk dat de rol van de computer in het onderzoeken van de Bijbel nog lang niet is uitgespeeld. De zoektocht naar patronen gaat door, en met nieuwe ontwikkelingen en nieuwe data blijven er steeds nieuwe vragen te onderzoeken om onze kennis te verdiepen. Want uiteindelijk gaat het niet om de data die de computer kan verwerken, maar om beter te luisteren naar wat de tekst zelf zegt.

Thijs Amersfoort, promotie kandidaat aan de VU Amsterdam.

- Rens Bod, Het Einde van de Geesteswetenschappen 1.0, 11. (Amsterdam 2012). ↩︎

- Voor een uitgebreidere beschrijving van de geschiedenis en methode, zie Reinoud Oosting. 2016. “Computer-Assisted Analysis of Old Testament Texts: The Contribution of the WIVU to Old Testament Scholarship.” In The Present State of Old Testament Studies in the Low Countries: A Collection of Old Testament Studies Published on the Occasion of the Seventy-fifth Anniversary of the Outtestamentisch Werkgezelschap, bewerkt door Klaas Spronk, 192-209. OTS 69. (Leiden, Brill, 2016) en Wido van Peursen en Cody Kingham, “The ETCBC Database of the Hebrew Bible.” In Journal for Semitics 17.1 (2018) ↩︎

- Deze methodologie wordt vaak omschreven als “bottom-up” en “form-to-function”. ↩︎

- Het programma maakte gebruik van Menu Query Language (MQL). ↩︎

- Voor een actueel overzicht van de afgeronde en lopende projecten, zie https://etcbc.nl/research-projects/ en https://vu.nl/en/about-vu/faculties/school-of-religion-and-theology/more-about/digital-approaches-to-sacred-texts-research-group. ↩︎

- Thijs Amersfoort, Verbal Valence Patterns as a Guide to Consistency in Translation. Lopend onderzoek. ↩︎

- Voor een uitgebreidere omschrijving van deze ontwikkeling, zie Willem van Peursen, “Computational Linguistic Analysis of the Biblical Text.” In Linguistic Theory and the Biblical Text, bewerkt door W. Ross en E Robar, 223-272 (Open Book Publishers, 2023). ↩︎

- In het onderzoek werd gekeken naar de inzetbaarheid van het AI-taalmodel Claude voor het maken van een vertaling van apocriefe boeken in de BGT-stijl. Zie Roemer Voorwinden, Wim Otte en Matthijs de Jong, “Wie vertaalt bepaalt!” In Met Andere Woorden 44.2, 37-45 (NBG 2025). ↩︎